分享文章

分享文章

造出世界最大芯片 AI芯片明星独角兽再获2.5亿美元融资

声明:该文章来自(芯东西)版权由原作者所有,K2OS渲染引擎提供网页加速服务。

曾造出世界最大芯片的美国 AI 芯片明星创企 Cerebras Systems,最新宣布完成 2.5 亿美元(约合 16 亿人民币)F 轮融资。此次融资由 Alphawave Ventures 和阿布扎比增长基金(ADG)领投。截至本轮融资,Cerebras 的融资总额已达 7.2 亿美元(约合 46 亿人民币),公司估值超过 40 亿美元(约合 256 亿人民币)。

2019 年 8 月,Cerebras 的首颗晶圆级芯片 WSE 一问世便轰动全球科技圈,它由一整片晶圆制成,在 46225mm² 面积上集成了 1.2 万亿个晶体管。其 2021 年推出的二代 WSE-2 更进一步,采用 7nm 制程,创下集成 2.6 万亿个晶体管的新纪录。

相比之下,被业界视作云端 AI 芯片标杆的英伟达 A100 GPU,同样采用 7nm 制程,总共有 540 亿个晶体管。

接下来,Cerebras 计划将此次融资用于扩大其全球业务和工程师团队,以及设计下一代基于台积电 5nm 节点的处理器。

01.创业伙伴再上路,投资人称正在重新定义 AI 的可能性

Cerebras Systems 位于美国加利福尼亚州,由 Andrew Feldman、Gary Lauterbach 等人创建于 2015 年。

Andrew Feldman 和 Gary Lauterbach 分别是 Cerebras Systems 的首席执行官和首席技术官,两人的合作时间已经超过 12 年。

Andrew Feldman 有着斯坦福大学的 MBA 学位,曾多次作为公司高管完成了收购和上市。Gary Lauterbach 则是行业中著名的计算机架构师,曾担任 SPARC Ⅲ 和 UltraSPARC Ⅳ 微处理器的首席架构师。

2007 年,Andrew Feldman 和 Gary Lauterbach 就一起创办了微型服务器公司 SeaMicro。2012 年,SeaMicro 被 AMD 以 3.34 亿美元收购,两人也一起加入了 AMD。Andrew Feldman 在 AMD 做了两年半的副总裁

Cerebras Systems 创建至今已完成了 6 轮融资,总金额达 7.2 亿美元。早在 2016 年,Cerebras Systems 完成了第一笔 6450 万美元的融资;次年 1 月,Cerebras Systems 拿下 2500 万美元的 B 轮融资;6 个月后,再次筹集 6000 万美元;2018 年 11 月,完成 8800 万美元的 D 轮融资。

随着不断地融资,Cerebras Systems 也从价值 2.45 亿美元的公司成为了新的 AI 芯片独角兽。Twitter、为 Snap 提供资金的 Benchmark,传奇芯片设计师、AMD 前 CTO Fred Weber、著名非营利实验室 OpenAI 的 AI 科学家、AlexNet 的联合创建者 Ilya Sutskever 等业界知名机构或大牛都对其进行了投资。

2019 年,Cerebras Systems 完成了 E 轮融资,公司估值约为 24 亿美元。如今,新的 F 轮融资为该公司又筹集了 2.5 亿美元的资金,而这相当于 Cerebras Systems 大约 6% 的股份,其估值已超过 40 亿美元。

据科技媒体 AnandTech 报道,这 2.5 亿美元的融资将会支撑 Cerebras 未来 2-3 年的布局,包括在 5nm 节点上设计芯片和新的内存扩展方案等。目前 Cerebras Systems 在美国桑尼维尔、美国圣地亚哥、加拿大多伦多、日本东京等地拥有约 400 名员工,并希望到 2022 年底扩大到 600 人,主要增加工程师人数并专注于产品的全栈开发。

Alphawave Ventures 的联合创始人兼董事长 Rick Gerson 称:“Cerebras Systems 正在重新定义人工智能的可能性,并在加快制药和生命科学等几个领域的创新方面有着一流的表现。我们很自豪能与 Andrew 和 Cerebras 的团队合作,支持他们将高性能 AI 计算引入全球新市场和地区。”

02.二代处理器具有 2.6 万亿个晶体管,性能提升超 1 倍

2019 年,Cerebras Systems 发布了其第一代 WSE 芯片,这款芯片具有 40 万个内核和 1.2 万亿个晶体管,使用台积电 16nm 工艺制程。

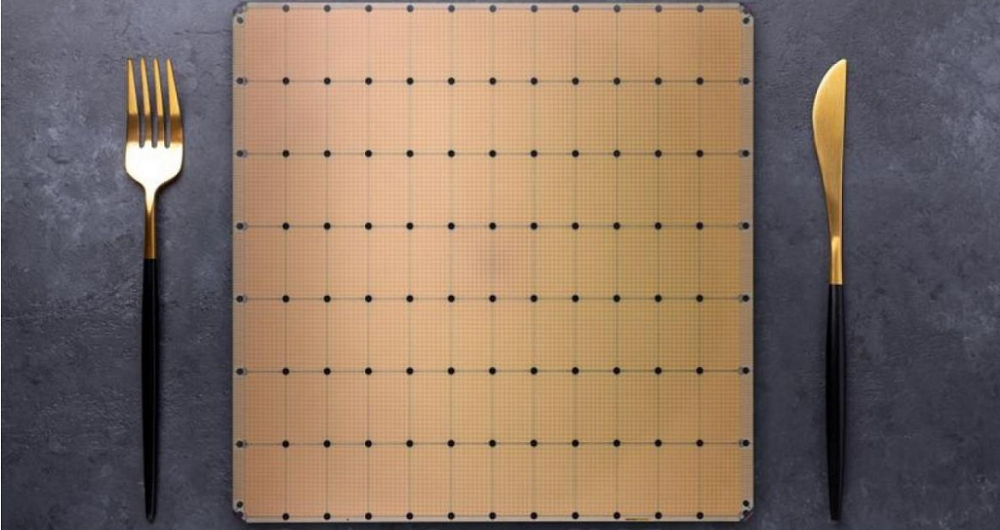

今年 4 月,Cerebras Systems 推出了第二代处理器 WSE-2,具有破纪录的 2.6 万亿个晶体管(市场上最大的 GPU 只有 540 亿个晶体管)和 85 万颗 AI 优化内核,大小类似餐盘,采用台积电的 7nm 工艺。相比于第一代 WSE 处理器,WSE-2 在 AI 内核数量、晶体管数量、密度、内存带宽等参数上都有着一倍以上的提升。

和当下的很多芯片不同,Cerebras Systems 的 WSE-1 和 WSE-2 并不是用晶圆上的一小部分制成,而是将整个直径为 300mm 的晶圆加工成 1 颗芯片。虽然这种芯片体积较大,但是由于晶体管和内核的数量、互连优势,相比同等算力的 GPU 集群,其功耗和所占空间都更小。

传统的 GPU 集群如果想要达到同等算力,需要数十个几架承载数百甚至数千个 GPU 芯片。而 CS-2 只有 26 英寸高,是标准数据中心机架的 1/3。

Cerebras Systems 的技术也在医药、天文、科研等多个领域发挥出了作用。

无论是美国阿贡国家实验室、劳伦斯利弗莫尔国家实验室、匹兹堡超算中心、爱丁堡大学超算中心等科研机构还是葛兰素史克、东京电子器件等厂商都成为了 Cerebras Systems 的忠实客户。

03.参数规模提升 100 倍,还在云端提供深度学习服务

今年 8 月 24 日,Cerebras Systems 还推出了世界上首个具备脑规模的 AI 解决方案。

人脑包含约 100 万亿个突触结构,而此前最大的人工智能硬件集群大约只有 1 万亿参数,类似于同等数量的突触,仅有人脑规模的 1%。而 Cerebras Systems 单一的 CS-2 支持超过 120 万亿参数,在规模上达到了人脑水平,推动了 AI 神经网络技术的发展。

阿贡国家实验室副主任 Rick Stevens 谈道:“Cerebras 的发明将提高 100 倍的参数容量,它有可能改变行业。我们将首次能够探索大脑大小的模型,开辟了广阔的研究和洞察的新途径。”

该解决方案包括四项核心技术,代号分别为 Weight Streaming、MemoryX、SwarmX 和 Sparsity。

Weight Streaming 可以让 AI 模型参数存储在芯片外,同时提供与芯片相同的训练和推理性能的能力,简化了工作负载分配模型。

MemoryX 是一种新的内存扩展技术,可实现 2.4 PTAB 的高性能内存,支持 120 万亿的参数模型。

SwarmX 是一种高性能、AI 优化的通信互连结构,可以互连多达 1.63 亿个 AI 内核,跨越 192 个 CS-2 系统协同工作,训练单个神经网络。

Sparsity 可以让用户选择模型的重量稀疏程度,减少模型处理所需的 FLOP 算力和时间。

9 月 16 日,美国深度学习云服务商 Cirrascale Cloud Services 宣布采用 CS-2 系统和 WSE-2 处理器。

在其应用中,8GPU 服务器比 CS-2 系统训练自然语言处理 NLP BERT 模型的时间慢 9.5 倍。而在训练精度上,用户需要超过 120 个 GPU 才能匹配单个 CS-2 系统的训练精度。

04.结语:Cerebras Systems 开拓巨型芯片路线获认可

需要指出的是,Cerebras Systems 的 WSE 系列芯片并非单纯的放大芯片尺寸。大尺寸芯片需要芯片企业在互连、芯片封装、散热等方面都有着独特的技术和解决方案,这些技术方案也体现在了 Cerebras Systems 脑规模 AI 解决方案中。

虽然其芯片的尺寸较大,无法用于 PC、移动设备等领域,但 Cerebras Systems 也向我们展示了巨型芯片的广阔应用前景,其产品可以在超算、云端等机构或企业的方案占据一席之地。而新一轮的融资代表了资本对这一技术路线的认可。

[超站]友情链接:

四季很好,只要有你,文娱排行榜:https://www.yaopaiming.com/

关注数据与安全,洞悉企业级服务市场:https://www.ijiandao.com/

- 1 农文旅融合绘就美丽乡村新图景 7905382

- 2 超级计算机算出人类灭绝时间 7968912

- 3 130亿三岁影帝接了多少广告 7830270

- 4 春回大地农事起 春耕备耕正当时 7775672

- 5 天雷滚滚我好怕怕传到联合国 7655483

- 6 下周将迎超级大回暖 气温火箭式飙升 7512824

- 7 男生用镜头记录下女友5年的蜕变 7449636

- 8 深圳女子报警:“我举报我自己” 7317993

- 9 美国将完全退出联合国?联合国回应 7219357

- 10 656吨“巨无霸”货车“优雅”前行 7105365