分享文章

分享文章

新闻分类

DeepSeek第二炸!开源首个用于MoE模型训练通信库

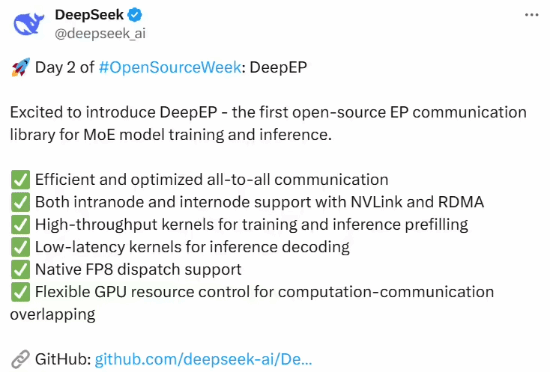

DeepSeek 的“开源周”活动今日已经来到第二天,今天发布的是首个开源的用于 MoE 模型训练和推理的 EP 通信库 ——DeepEP。

官方表示其具备如下特征:

高效优化的全到全通信方式

支持节点内外通信,兼容 NVLink 和 RDMA 技术

提供高吞吐量的内核,提升训练和推理前期填充效率

提供低延迟内核,优化推理解码速度

完全支持 FP8 数据格式调度

提供灵活的 GPU 资源管理,支持计算与通信的重叠执行

据介绍,DeepEP 是一款专为混合专家(MoE)和专家并行(EP)设计的通信库,提供了高吞吐量和低延迟的 all-to-all GPU 内核,常用于 MoE 派发和合并操作。该库还支持低精度计算,包括 FP8。

为了与 DeepSeek-V3 论文中提出的组限制门控算法兼容,DeepEP 提供了一些针对不对称带宽转发优化的内核,比如将数据从 NVLink 域转发到 RDMA 域。这些优化的内核能够提供高吞吐量,适合用于训练和推理的预填充任务,同时支持 SM(流式多处理器)数量控制。

对于延迟敏感型的推理解码任务,DeepEP 提供了一套低延迟内核,采用纯 RDMA 技术以最大程度减少延迟。此外,该库还采用了一种基于 Hook 的通信与计算重叠方法,不会占用任何 SM 资源。

[超站]友情链接:

四季很好,只要有你,文娱排行榜:https://www.yaopaiming.com/

关注数据与安全,洞悉企业级服务市场:https://www.ijiandao.com/

关注网络尖刀微信公众号

关注网络尖刀微信公众号随时掌握互联网精彩

赞助链接

排名

热点

搜索指数

- 1 习近平田间考察记 7958349

- 2 男子照顾独居老人12年继承北京5套房 7909855

- 3 诈骗电话又出坑人新招 7875745

- 4 看哪里即将“签收”春天 7700436

- 5 《北上》导演因白鹿太漂亮有过顾虑 7651967

- 6 每年因乳腺癌死亡的人数将增加68% 7523610

- 7 《演员请就位3》暂停播出 7405276

- 8 考了这些证书的可享个税扣除 7336127

- 9 郭涛儿子石头18岁近照 7251384

- 10 华为或首发国产一英寸大底 7160174

大乔9

大乔9